오늘도 {{active_subscriber_count}} 명의 창업가와 투자자가 주실밸과 함께합니다.

TLDR for AI

Anthropic이 펜타곤에 요구를 거절했습니다. 대량 감시와 자율 무기에 Claude를 쓰지 말라는 조건이었습니다. 이에 트럼프 대통령은 Anthropic을 간첩취급하며 연방정부 전체에서 퇴출시켰고, 수시간 뒤 OpenAI가 그 자리를 차지했습니다. 하지만 이란 공습 당일, 미군은 여전히 Claude를 쓰고 있었습니다. 오늘은 이 두 회사를 나란히 놓고 비교해봤습니다.

Anthropic 3, OpenAI 2, 접전 2. 다만 Anthropic에게도 불편한 질문이 남아 있습니다.

트럼프가 퇴출시킨 AI가 앱스토어 1위가 된 이유

우선 지난 금요일, AI 업계에서 벌어진 일들을 정리해보겠습니다.

Anthropic이 Pentagon에 “No” — 미국인 대량 감시와 자율 살상 무기에 Claude 사용을 거부

샘알트만이 “Anthropic과 같은 레드라인”이라고 공개 지지 — 내부 메모로 직원들에게 같은 입장이라고 밝힘

Trump가 Anthropic을 국방부뿐만 아니라 연방정부 전체에서 퇴출 — “supply chain risk” 지정. 보통 중국·러시아 기업에게나 붙이는 딱지

몇시간 후, 샘알트만이 “같은 조건”으로 Pentagon 딜 체결 — 당연히 같은 조건이 아닌 것으로 알려졌고 뒤통수를 쳤다는 반응

같은 날, OpenAI가 $730B 밸류에이션으로 $110B 펀딩 발표 — Amazon $50B, Nvidia $30B, SoftBank $30B

그리고 가장 아이러니한 건 사실:

Trump가 Anthropic ban을 선언한 바로 그 시간, 미군은 이란 공습에 Claude를 쓰고 있었습니다. WSJ 보도에 따르면, 미 중부사령부(CENTCOM)는 이란 공습에서 정보 분석, 타겟 식별, 전투 시나리오 시뮬레이션에 Claude를 사용했습니다. 연방정부 전체 사용 금지하겠다고 해놓고 바로 실전에서 쓴 겁니다.

사실 이 사건을 제대로 읽으려면, 이 두 회사의 출발점부터 봐야 합니다.

Anthropic은 OpenAI에서 독립한 팀이 만든 회사입니다. 2020년, OpenAI의 연구 부사장이었던 Dario Amodei 가 GPT-2와 GPT-3 개발을 이끈 핵심 연구자 7명과 함께 나와서 시작한 회사인거죠.

그렇다면 왜 OpenAI를 나왔을까요? Dario의 표현을 빌리면 “다른 사람의 비전과 싸우는 건 너무 비생산적이라서, 믿을 수 있는 사람들을 데리고 나와서 직접 만들기로 했다.”라고 합니다.

뻔한 말보다 더 알려진 핵심 갈등은 OpenAI가 2019년 비영리에서 영리로 전환하고 Microsoft의 $1B 투자를 받으면서, 상업적 속도가 안전보다 우선되기 시작했다는 불만이었다고 합니다. 모델은 점점 강력해지는데, 안전 장치는 그 속도를 따라가지 못하고 있다는 것이 OpenAI에서는 받아들여지지 않았다는 이야기죠.

지난주 컨퍼런스에서 다들 손잡았는데 둘이서만 손 안잡음 ㅋㅋㅋ 쪼잔하다 정말

그리고 그로부터 6년이 된 지금, 지난 주말은 Dario가 OpenAI를 떠난 이유를 다시 한번 증명하는 사건이 되었습니다.

그래서 오늘은 이번 세대 인공지능의 선두자리를 다투고 있는 OpenAI와 Anthropic, 두 회사를 이번 사건에 비추어 자본, 기술, B2B, B2C, 정치, 인재, 대표등으로 비교해보고 그 함의를 생각해보려고 합니다.

1. Capital — 누가 진짜 돈이 있는가

OpenAI

“OpenAI $110B 펀딩!” 어마어마한 돈을 받은 것은 사실이지만, 여전히 애매한 부분은 있습니다.

Amazon의 $50B 투자 핵심 조건을 보면, OpenAI는 AWS에 향후 8년간 $100B을 추가 지출하기로 했습니다. Trainium 칩 2GW 사용도 약속했고요. $50B 넣고 $100B+ 돌려받는 구조입니다. 이건 투자가 아니라 vendor financing입니다. Nvidia $30B도 GPU 구매로 순환되는 구조이고, SoftBank $30B은 상대적으로 순수 지분투자에 가깝지만 Stargate JV를 통해 간접적으로 묶여 있습니다.

그렇다고 하더라도, 매출 성장은 인상적입니다. 2023년 $2B → 2024년 $6B → 2025년 $13B, ARR 기준 $20B+. 매년 3배 성장. ChatGPT WAU도 900M을 넘었고요.

그런데도 계속 이런 거대한 규모의 펀딩이 필요한 이유가 있습니다. 2025년 현금 소각 $9B → 2026년 예상 $14-17B. 현금흐름 흑자 전환은 잘해봐야 2030년으로 예상됩니다. 2023년부터 2028년까지 누적 $44B 적자 예상이고, 추가로 $50-80B을 더 조달해야 버틸 수 있는 것으로 알려졌습니다.

$730B 밸류에이션을 받았지만 2030년까지 현금흐름 적자입니다. 더욱이 이 밸류에이션의 전제인 2030년 매출 타겟이 $280B인데, 2025년 $13B에서 5년 만에 20배. 꽤(?) 공격적인 가정입니다.

개인적으로 인공지능 시장이 이렇게 커질 것이라는 부분은 동의하지만, OpenAI가 그렇게 성장할지는 확신이 없네요.

Anthropic

Anthropic도 최근에 $380B 밸류에이션에 $30B 시리즈 G를 클로징했습니다. 매출은 14개월 만에 $1B에서 $14B으로 14배 성장한 것으로 알려졌습니다 (SaaStr, 2026.02).

“Anthropic 자금줄이 마른다”는 내러티브가 돌았는데, $44B 적자를 메워야 하는 쪽은 OpenAI지, Anthropic이 아닙니다.

다만 Anthropic의 $380B 밸류에이션도 $14B ARR 기준 27배 멀티플입니다. Google 의존도도 여전히 높고요. OpenAI의 vendor financing 구조가 문제라면, Anthropic의 밸류에이션 프리미엄도 같은 잣대로 물어야 합니다.

종합하면 절대적 조달 규모에서는 OpenAI가 압도적입니다. 다만 vendor financing 구조와 $44B 누적 적자를 감안하면, 헤드라인만큼의 여유는 아닙니다.

Capital 판정: OpenAI 승

2. Technology — 누가 진짜 앞서 있는가

OpenAI

2월 5일, OpenAI는 GPT-5.3 Codex를 출시했습니다. 같은 날 Anthropic이 Claude Opus 4.6을 내놓으면서, AI 코딩 역사상 가장 의미있는 동시 출시가 벌어졌습니다. GPT-5.3 Codex는 터미널·컴퓨터 사용 영역에서 강력합니다. Terminal-Bench 2.0에서 77.3%, OSWorld에서 64.7%. 전작 대비 25% 빠르고 토큰 소모도 2-4배 적습니다.

Anthropic

Claude Opus 4.6은 추론 중심 벤치마크를 장악했습니다. SWE-bench Verified 80.8%, GPQA Diamond, MMLU Pro, TAU-bench에서 모두 선두. 다만 두 모델이 서로 다른 벤치마크 변형을 사용하기 때문에 (Opus는 SWE-bench Verified, Codex는 Terminal-Bench) 직접 점수 비교는 조심해야 합니다.

실전 검증은 더 강력합니다. Claude는 Pentagon의 classified network에 배치된 유일한 AI 모델이었고, Maduro 체포 작전에도, 이란 공습 당일에도 CENTCOM이 Claude로 정보분석·타겟식별·전투시뮬레이션을 수행했습니다. CSIS의 Gregory Allen은 CNN과의 인터뷰(2026.02)에서 “국방부 내부에서 Claude를 좋아하고, 사용 제한이 문제된 적이 없다”고 인정했습니다.

킬러 프로덕트 Claude Code는 GA 출시 후 10개월 만에 런레이트 $2.5B을 찍었습니다. 주간 활성 사용자 2배, 비즈니스 구독 4배 성장. 2월부터 GitHub Copilot에서도 Claude Opus 4.6을 쓸 수 있게 됐습니다 (GitHub Blog, 2026.02).

개인적으로 저도 Claude를 주력으로 쓰고 있습니다. Claude Code와 Cowork 기능이 워낙 좋아서, 다른 도구 없이도 대부분의 작업을 처리할 수 있을 만큼 발전했습니다. Gemini를 완전히 끊지는 못하고 있는데, 생태계와 가격 번들링이 워낙 강력해서 완전히 끊어내기가 어려운 구조입니다. 이건 아마 많은 사용자들이 비슷하게 느끼고 있을 거라고 생각합니다.

따라서 벤치마크로 보았을때는 추론·코딩은 Anthropic, 터미널·실행 속도는 OpenAI. 실전 검증(Pentagon)은 Anthropic이 앞서지만, 각자 강한 영역이 달라 아직 한 쪽의 승리라고 부르기엔 격차가 좁습니다.

Technology 판정: 접전.

3. B2B — 엔터프라이즈는 이미 움직였다

OpenAI

Menlo Ventures의 엔터프라이즈 LLM 시장 리포트에 따르면 B2B시장 점유율은 2년 만에 50%에서 27%로. 거의 절반이 날아갔습니다. 미국의 법인카드 스타트업인 Ramp 데이터에 따르면, OpenAI에 돈 내는 기업의 79%가 Anthropic에도 돈 내고 있습니다. 방향성은 명확합니다 — 2년 전에는 OpenAI가 없으면 안 됐는데, 지금은 Anthropic이 없으면 안 되는 구조로 바뀌고 있습니다.

Anthropic

Fortune 10 기업 중 8개가 Claude 고객이고, 연간 $1M 이상 쓰는 고객이 2년 전 12개에서 500개 이상으로 늘었습니다. 코딩 시장에서는 Anthropic이 54%, OpenAI는 21%입니다.

며칠전 사태후에 흐름을 느낀 Anthropic이 다른 인공지능 사용자들을 데리고 오는데에도 매우 적극적이라는 점도 재미있습니다. 다른 AI 툴에서 데이터를 엑스포트해서 Claude로 가져오는 방법을 직접 작성해 홈페이지에 올릴 정도입니다. 물이 들어올때 노를 아주 잘 젓고 있는 모습이네요.

GPT의 기억을 클로드로 옮기기: https://claude.com/import-memory

따라서 시장 점유율을 역전한 Anthropic이 엔터프라이즈에서 이미 1위입니다.

B2B 판정: Anthropic.

4. B2C — 소비자 시장의 역전

OpenAI

Fortune의 지난달 기사에 따르면 ChatGPT의 웹 트래픽 점유율은 2025년 1월 86.7%에서 2026년 1월 64.5%로 떨어졌습니다. 모바일도 69.1%에서 45.3%로 급락했구요.

더군다나 Pentagon 딜 이후 상황이 급격하게 악화되고 있습니다. 지금은 모더레이터에 의해 삭제되었지만 ChatGPT 섭레딧에서 “Cancel and Delete ChatGPT!!!” 포스트가 3만 업보트를 찍었고, CancelChatGPT.com이라는 전용 사이트까지 등장했습니다. OpenAI 비판 정리 + 계정 삭제 가이드를 제공하는 사이트입니다. 이게 일시적 분노가 아니라 브랜드 이탈의 신호일지는 좀 더 지켜봐야겠지만, 생각보다 분위기가 더 차갑습니다.

Anthropic

사실 Anthropic의 B2C 공략은 지난달 Super Bowl 광고가 시작이었습니다. “Ads are coming to AI. But not to Claude.” - OpenAI가 ChatGPT에 광고를 넣겠다고 한 걸 정면으로 겨냥한 포지셔닝 선언이었습니다.

더 재미있는건 샘알트만이 에세이급 반박문을 올리면서 오히려 더 어그로를 끌어줬습니다. Galloway(NYU 마케팅 교수)는 이 반응 자체가 전략적 실수라고 분석했습니다 - “He just comes across as defensive.” 그리고 아이러니하게도, ChatGPT가 실제로 첫 광고를 송출한 건 Anthropic Super Bowl 광고가 나간 바로 몇 시간 뒤였습니다.

CNBC가 보도한 결과는 Claude App Store 41위 → 7위, 다운로드 32% 증가, DAU 11% 상승했습니다. 대성공이었죠.

그리고 사라져가는 이 불꽃에 샘알트만이 Pentagon 사건으로 기름을 부어준 셈이 되었습니다. Axios에 따르면 3월 1일 기준, Claude가 미국 Apple App Store 무료앱 전체 1위에 등극했습니다. ChatGPT를 제치고. 독일과 캐나다에서도 1위를 한거죠. 1월 말까지 App Store 100위권에도 없던 앱이 Super Bowl이후에 2위까지 올라왔고, 그리고 Pentagon 사건으로 총 두 달 만에 1위가 된 겁니다.

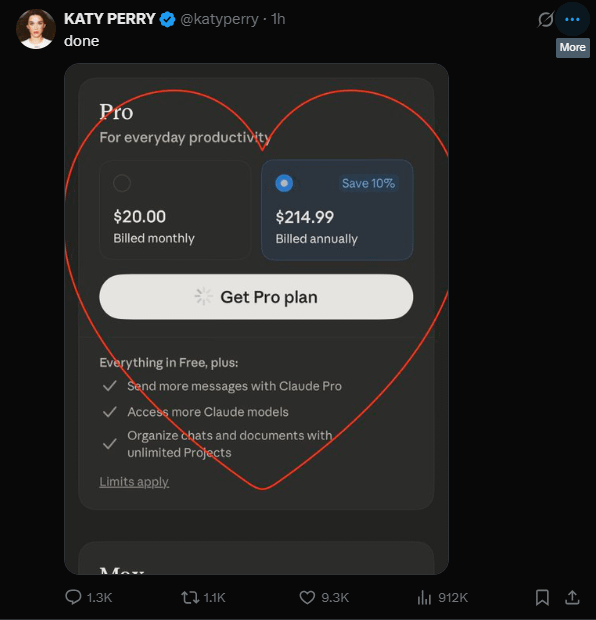

이번 사태로 셀럽들의 지지도 이어지고 있는데, 요즘 젊은이들은 모르지만 우리 구독자 여러분들은 잘 아시는 Katy Perry가 Claude Pro 구독 페이지를 캡처해서 X에 하트를 달고 공유할 정도입니다.

이건 우연이 아니라, 제품력 + 브랜딩 + 정치적 반사이익이 한꺼번에 폭발한 거라고 생각합니다. Trump 정부가 Anthropic을 퇴출시키자, 소비자들이 “그럼 나는 이 회사 편”이라고 지갑을 열기 시작한 거죠. OpenAI가 정부를 얻는 동안, Anthropic은 시장을 얻고 있습니다.

물론 이 App Store 1위가 얼마나 지속될지는 모르겠지만, 가장 중요한 건 순위가 아니라, 이 기간에 유입된 사용자들이 남느냐(나왔다 리텐션무새…!)입니다. 개인적으로는 Anthropic의 제품이 실제로 좋기 때문에 retention이 나쁘지 않을 거라고 봅니다.

하지만 그렇다고 하더라도 ChatGPT의 절대적 사용자 수는 여전히 압도적입니다. 다만 모멘텀은 명확히 바뀌고 있습니다. App Store 1위 등극과 #CancelChatGPT 운동은 일시적 현상일 수 있지만, 브랜드 이탈의 초기 신호로 볼 충분한 근거가 있습니다.

B2C 판정: OpenAI.

5. Customer-Politics: 같은 레드라인이 아니다

개인적으로 이게 가장 중요한 구조적 포인트라고 생각합니다. 고객과 회사의 정치적인 alignment에서의 관점인데, 정치적 이념보다는 비지니스 차원에서 성향을 바라본 시각이라고 생각해주시면 좋겠습니다.

지금 샘알트만이 겪는 문제는 일론머스크가 Tesla에서 겪었던 그것과 같다고 봅니다. Tesla의 주요 고객은 인프라가 있는 메트로의 구매력 있는 소비자들입니다. 하지만 일론머스크가 이들의 가치에 반하는 정책에 올인한 결과로 Tesla는 핵심 고객층의 반발을 샀다고 생각합니다.

OpenAI

그렇다면 지금 AI를 가장 많이 쓰고, 가장 많이 돈 내는 고객이 누구일까요? 당연히 테크 기업, 스타트업, 개발자, 연구자 — 대부분 San Francisco, New York, Seattle에 있는 사람들입니다.

샘알트만은 이번에 Anthropic의 편을 드는 척하다가 뒤통수를 치고 정부 계약을 받아들이면서 “Anthropic과 같은 조건”이라고 주장했습니다. 근데 합리적으로 생각했을 때 정부가 같은 조건을 두고 굳이 OpenAI를 선택했을 이유는 없겠죠. 실리콘밸리에서 가장 합리적으로 나오고 있는 의심은 이겁니다 — Anthropic과 OpenAI의 레드라인은 같은 레드라인이 아니다.

The Verge가 3월 2일 이 의심을 사실상 확인했다고 주장합니다. OpenAI의 Pentagon 계약 핵심은 세 글자로 요약됩니다: “any lawful use.” 법적으로 합법이면 미군이 OpenAI 기술로 무엇을 하든 허용하는 구조입니다.

문제는 “합법”의 정의입니다. 샘알트만이 근거로 든 법률 — EO 12333, FISA, National Security Act — 이 법률들이 바로 2013년 Snowden이 폭로한 대규모 국내 감시 프로그램을 가능하게 한 법적 근거입니다. Verizon 고객 전화 기록을 매일 수집하고, PRISM으로 Google·Apple·Microsoft에서 데이터를 빨아들인 것이 이 법률 하에서 “합법”이었습니다.

OpenAI의 전 정책연구 책임자 Miles Brundage가 이렇게 말했습니다.

“OpenAI caved + framed it as not caving, and screwed Anthropic while framing it as helping them”

“OpenAI는 국방부의 조건을 들어주면서 들어주지 않은 것처럼 포장했고, Anthropic을 돕는 것처럼 말하면서 실제로는 Anthropic의 뒷통수를 쳤다".

결정적으로, Trump 행정부의 차관 Jeremy Lewin이 직접 인정했습니다 — 이건 “compromise that Anthropic was offered, and rejected.” Anthropic이 같은 딜을 먼저 받았고, 거부한 것입니다. 정부 관계자가 직접 “같은 조건이 아니다”를 확인해준 겁니다.

Anthropic은 bulk data collection을 구체적으로 금지하는 조항을 요구했습니다. OpenAI는 기존 법률 준수로 충분하다고 했습니다. 이처럼 샘알트만의 주장과는 달리 둘은 분명히 다른 레드라인입니다.

Anthropic

한 가지 더 짚고 넘어가자면, Anthropic이 거부한 건 군사적 용도의 특정 조건입니다. 대량 감시, 자율 무기 — 즉 국방부 관련 이슈입니다. 이번 사태로 만약 국방부에서 Anthropic 사용을 제한했다면, 그건 충분히 이해할 수 있고 존중해야 하는 결정이라고 생각합니다.

다만 지금 벌어지고 있는 일은 이게 아닙니다. 정부는 Anthropic을 “supply chain risk”로 지정해서 연방정부 전체에서 퇴출시키겠다고 선언했습니다. 교육부, 보건부, NASA — 군사와 무관한 기관들까지 전부요. 이건 정책적 판단이 아니라 보복에 가깝습니다. 참고로 supply chain risk designation은 지금까지 중국·러시아 기업에만 적용되어 왔습니다. 최고의 기술력을 가진 미국 기업에 이 딱지가 붙은 건 Anthropic이 역사상 처음입니다.

다만 — 실제로 이 모든 게 적용되지 않을 것으로 보입니다.

Axios에 따르면, 국방부장관인 Hegseth의 트윗은 법적 근거보다 훨씬 과장된 내용이었다고 합니다. 예를 들어, “군과 거래하는 모든 기업은 Anthropic과 거래할 수 없다”고 했는데, 이 논리대로면 Nvidia도 Anthropic에 칩을 팔 수 없게 됩니다 — Nvidia가 국방부와 거래하니까. 말이 안 되죠.

실제로 국방부는 아직 Anthropic에 supply chain risk designation의 공식 통보도 하지 않았습니다. 만약 공식 통보가 된다면 Anthropic은 이는 국방부 계약 범위 내에서만 적용되며, 다른 상업 고객이나 파트너에게는 영향이 없다는 취지의 법적 대응을 예고했습니다.

그렇다고 Anthropic은 천사이고 OpenAI는 악마인가?

여기까지 읽으면 Anthropic이 완전한 도덕적 승리를 거둔 것 같지만, 그것도 사실이 아닙니다.

Ben Thompson(Stratechery)이 이번 사건에 대해 가장 날카로운 반론을 제기했습니다. 핵심은 이겁니다: 비선출직 CEO가 미군이 기술을 어떻게 쓸지 거부권을 행사하는 게 맞느냐?

솔직히 아주 공감하는 부분입니다. 다만 이런 반론이 나오게 된 건 Anthropic CEO가 펀드레이징을 위해 과도한 공포감과 hype으로 거품을 조성했기 때문이라고 생각합니다. Dario가 Davos에서 “AI 칩을 중국에 파는 건 북한에 핵무기를 파는 것과 같다”고 했습니다. 이 비유를 문자 그대로 받아들이면? 핵무기급 기술을 만드는 민간 기업이 미국 정부에 사용 조건을 걸겠다는 건, 국가 입장에서는 용납할 수 없는 독립적 권력 구조입니다. (이 부분은 CEO Risk 섹션에서 더 깊이 다룹니다.)

그런데 — Thompson의 논리도 한계가 있습니다.

“민주적 통제”라는 원칙은 맞습니다. 다만 이번에 실제로 벌어진 건 “민주적 통제”가 아니었습니다. Anthropic이 요구한 건 구체적이었어요 — Axios 보도에 따르면, 미국인의 위치정보, 웹 브라우징, 금융기록을 데이터 브로커에서 bulk 구매해서 AI에 돌리지 말라는 것. 합리적인 요구입니다. 그런데 Pentagon이 거부했고, Trump 정부는 국방부 제한이 아니라 연방정부 전체 퇴출 + supply chain risk 지정으로 응답했습니다. 이건 민주적 감시가 아니라 punitive retaliation입니다.

결정적인 포인트는 이겁니다: 만약 두 회사의 조건이 정말로 동일했다면, Trump 정부가 OpenAI로 바꿀 이유가 없습니다. Pentagon은 이미 Claude를 classified network에 배치했고, 이란 공습에서 실전으로 검증했고, 내부에서도 좋아한다는 평가가 나왔습니다. 기술적으로 더 좋은 걸 쓰고 있었는데 굳이 같은 조건의 다른 회사로 바꾸겠습니까? 바꿨다는 건, 조건이 같지 않다는 뜻입니다.

민주적 감시 논증은 원칙적으로 맞지만, 이번 사건에서 실제로 벌어진 건 민주적 감시가 아니라 정치적 보복이었습니다. 단기적으로는 정부 계약을 잃었지만, 핵심 고객층(테크·개발자)의 신뢰를 얻었고, 소비자들은 지갑으로 투표하고 있습니다.

Customer-Politics 판정: Anthropic.

6. Talent — 인재는 어디로 가고 있는가

OpenAI

사실 지금의 인공지능 판은 B2C 고객의 숫자가 빠지는 것보다 인재들이 빠지는 게 더 무섭습니다.

공동 창업자 Ilya Sutskever가 떠나 SSI를 설립했고, CTO Mira Murati는 Thinking Machines Lab을 세웠습니다 — $12B 밸류에이션에 $2B 조달 (Built In, 2025). 공동 창업자 John Schulman은 Anthropic으로 갔습니다. 2025년 여름에는 연구자 7명이 한꺼번에 Meta Superintelligence Lab으로 이직했습니다 (Business Insider, 2025). 샘알트만은 지금 OpenAI에 남아있는 유일한 활동 중인 공동 창업 멤버입니다.

더군다나 Google(772명)과 OpenAI(97명) 현직 직원들이 “We Will Not Be Divided”라는 공개 서한에 서명하며 Anthropic과 연대했습니다. 2023년 해고 사태 때 직원들이 샘알트만의 복귀를 요구했던 것과 정반대 방향입니다. 그때는 샘이 직원들의 영웅이었는데, 지금은 직원들이 경쟁사와 연대하고 있습니다.

Anthropic

인공지능 개발자들 입장에서는 지금 Anthropic으로 가면 더 빠르게 성장하는 “도전자” 회사에 올라탈수 있고, $380B 밸류에이션 회사의 pre-IPO 주식을 받을 수 있고, 사명감도 유지할 수 있고, 이번달 말에 예정되어있는 일론머스크의 소송을 비롯한 수많은 소송으로부터 자유로워질수있고, 결정적으로 돈과 권력을 위해 정부에게 시민들을 팔아넘긴 기업의 이미지를 벗어날 수 있습니다.

실리콘밸리에서는, 특히 인공지능 개발자와 같이 이미 많은 돈을 버는 사람들은 이런 가치와 비전에 대해서 생각보다 훨씬 더 중요하게 여긴다고 느껴지는만큼, OpenAI에서 Anthropic으로 가는 건 리스크가 아니라 합리적인 커리어 결정이 되어가고 있습니다.

업계에서는 세계 최고 수준의 인공지능 엔지니어가 100명이 안 된다는 말이 있습니다. 그걸 사실이라고 가정하면, 이번 사태로 인한 인재 유출은 OpenAI에게 막타가 될 수도 있습니다.

다만…

청원 서명과 실제 이직은 완전히 다른 행위입니다. 그리고 OpenAI에 남을 이유도 분명히 있습니다. 인공지능의 대명사인 회사, $730B 밸류에이션의 RSU, 업계 최대 규모의 컴퓨트 인프라, GPT-5 이후의 연구 로드맵, 그리고 900M WAU 플랫폼 위에서 만드는 제품의 임팩트. 사명감으로 움직이는 엔지니어도 있지만, 자기 연구를 가장 큰 스케일에서 돌려보고 싶은 엔지니어도 있습니다. 돈만 보면 OpenAI가 아직 더 크고, 스케일만 보면 비교 자체가 안 됩니다.

그렇기때문에 더욱 더 앞으로 6개월, 저 97명의 서명들이 LinkedIn 업데이트로 바뀌는지가 이번 사태의 진짜 결말을 결정합니다. 개인적으로 올해 가장 지켜볼만한 꿀잼포인트라고 생각합니다.

Talent 판정: 접전.

7. CEO Risk — Integrity의 문제

OpenAI

2024년에 “위대한 OpenAI의 위험한 도박”에서 정리했듯이, 샘알트만에게는 반복되는 패턴이 있습니다:

보드멤버들에게 “정보를 숨기고, 왜곡하고, 거짓말”했다는 Helen Toner의 증언

Scarlett Johansson이 거절한 목소리를 유사하게 만들어 출시한 ‘Sky’ 사건

퇴사자 주식 회수 협박 독소조항 — 샘알트만은 “몰랐다”고 했지만 유출 문서에 서명이 있었습니다

OpenAI Fund를 본인 명의로 등록해둔 사건

퇴사자들의 평가: “기만적이고, 조종적이며, 거짓말을 하고, 더 나쁘기도 하다”

이번 Pentagon 딜도 같은 구조입니다. “나도 같은 레드라인”이라고 공개적으로 말해놓고, 수시간 뒤에 그 자리를 차지했습니다. 앞에서는 지지하는 척하고, 뒤에서 뒤통수를 치는 — 퇴사자들이 말한 “모든 사람에게 일단 모든 것이 되려는 습관”의 정확한 반복입니다.

TechCrunch 인터뷰에서 샘알트만 본인이 “definitely rushed”라고 인정했고, “the optics don’t look good”이라고도 했습니다. 근데 사실 보기에 안 좋은 게 아니라, 실제로 안 좋은 겁니다.

그러면서 시키지도 않았는데 스스로 급하게 X에서 AMA까지 열었다는 건, 내러티브 통제가 필요하다고 판단했다는 뜻입니다. 다만 그 AMA도 방어적이라는 인상을 강화하는 결과로 이어졌습니다.

다시 말해 샘알트만의 CEO 리스크는 일회성 사건이 아닙니다. 보드 해임 때도, Sky 사건 때도, 퇴사자 독소조항 때도, 그리고 이번 Pentagon 딜에서도 — 매번 같은 패턴의 반복입니다. 앞에서는 원칙을 말하고, 뒤에서는 반대로 행동하는 구조. 이건 실수가 아니라 행동 양식입니다.

Anthropic

물론 Dario도 완벽한 사람은 아닙니다. 솔직히 말하면 Dario에게는 “거품의 부메랑” 문제가 있습니다.

Dario는 AI 리스크에 대해 “치명적 AI 사건 확률 25%”라고 말해서 과장이라는 비판을 받았고, 백악관에서는 “겁 주기(fear-mongering)”라고 했습니다. Davos에서는 “AI 칩을 중국에 파는 건 북한에 핵무기를 파는 것과 같다”고까지 했습니다. Meta의 Yann LeCun은 Anthropic이 오픈소스 모델을 규제하려고 로비한다고 비판했고, Biden의 AI 행정명령도 Anthropic이 주요 로비 세력이었습니다.

여기서 구조적 아이러니가 나옵니다. “AI는 핵무기급으로 위험합니다”라고 세상을 설득하면, 정부가 “그럼 핵무기처럼 통제하겠습니다”라고 대응하는 건 당연한 수순입니다. 위험을 과대포장해서 펀드레이징하고, 규제를 만들어서 경쟁사를 막고, 안전을 브랜딩으로 쓰다가 — 그 거품이 부메랑이 되어 자기를 덮친 겁니다.

그렇다고 하더라도, 이번 Pentagon 사건이 보여준 Dario의 integrity는 명확합니다. hype와 과장의 문제가 있지만, $200M 계약을 거부하고, 연방정부 퇴출까지 감수했습니다. “cannot in good conscience”라고 말하고 그 대가를 실제로 치렀습니다. 안전을 마케팅으로만 쓰는 회사가 이런 선택을 하지는 않습니다. 문제는 안전에 대한 진정성이 아니라, 안전을 파는 방식이었습니다.

한 가지 더 — Dario는 자율 무기를 영원히 반대하는 것은 아닙니다. The Verge에 따르면, Dario는 자율 무기가 “may prove critical for national defense”라고 인정하면서도, 현재 기술 수준에서는 “not reliable enough today”라고 판단한 겁니다. 원칙이 아니라 타이밍의 문제라는 건데 — 이건 pragmatist의 판단이지, 이상주의자의 선언이 아닙니다. 솔직히 이게 더 신뢰가 가고, Ben Thompson의 “비선출직의 권력”에 대한 우려에도 적절한 대답이 된다고 생각합니다.

Integrity라는 가치

개인적으로 저는 파운더의 integrity에 대해 민감한 편입니다. Luna 사태를 봐도, FTX를 봐도 — 결국 파운더의 integrity가 무너지면 회사 전체가 무너집니다. 연기가 자욱한데도 불은 없겠지라고 생각하다 큰 코를 다치는 케이스를 실제로 많이 겪어봤고 봐왔습니다.

Dario가 hype하고, 때로는 겁을 주는 면이 있습니다. 다만 이번 사건을 통해 — 샘알트만의 문제점 리스트와 비교했을 때 — 상대적으로 integrity가 있는 파운더라는 인상을 받았습니다. 말한 것을 실제로 지키는 사람인지가 중요하고, 이번에 Dario는 그걸 증명했습니다.

Dario에게 “거품의 부메랑” 문제가 있지만, 샘알트만에게는 패턴화된 신뢰의 문제가 있습니다. hype와 dishonesty는 급이 다릅니다. 전자는 고칠 수 있지만, 후자는 구조적입니다.

CEO Risk 판정: Anthropic.

그래서 어쩌라고?

AI판의 게임이 바뀌고 있습니다. 다만 바뀌는 방향이 대부분의 헤드라인이 말하는 것과 좀 다릅니다. 정치가 기술을 이긴 것처럼 보이지만, 실전에서는 여전히 기술이 이기고 있습니다. 소비자들은 App Store에서 투표하고 있고, 개발자들은 코드 에디터에서 투표하고 있고, 엔지니어들은 이력서로 투표하고 있습니다.

너무나도 빠르게 변하는 시장입니다. 끝없이 쏟아지는 새로운 기능들, 너도나도 만들 수 있으니까 만드는 — 더 이상은 아무도 돈 내지 않을 — 30분만에 만든 과거의 유물들. 이런 것들 조차도 매일매일 따라가지 않으면 뒤쳐질 것 같은 FOMO가 우리를 자극하고 괴롭히고 있습니다.

이 모든 흐름의 최전선에 있는 입장에서, VC들은 점점 철학가가 되어가는 것 같습니다. 자꾸 미래의 사회를 생각하고, 제도를 생각하고, 법을 생각합니다 (이것이 바로 Next Michigan 3편!!!)

그러다보니 디스토피안적인 미래도 많이 보이는 게 지치기도 하지만 동시에 앞으로 펼쳐질 세상이 너무 기대가 되기도 합니다. 어쨌든 인공지능은 우리가 사는 세상을 지금보다 100배, 아니 10,000배 더 좋은 세상으로 만들 수도 있는 도구니까요.

다 같이 지치고 힘드실 여러분들께서도 함께 이야기하고 힘내서, 다가올 세상을 좀 더 좋은 세상으로 만드는데 보탬이되는 주실밸 커뮤니티가 되면 좋겠습니다.

저의 감성이 전형적인 실리콘밸리 같고 너무 뜬구름 같다고요? 인공지능 기술자들은 저 같은 VC들보다 훨씬 더 미래에 대한 강한 책임감과 비전을 가지고 있습니다. 그래서 더 꿀잼일듯하네요 ㅋㅋㅋ같이 팝콘먹으면서 지켜보시죠!

오늘도 읽어주셔서 감사합니다.

이안 드림

주간실리콘밸리 — 가장 주관적이고, 가장 편파적인 실리콘밸리 뉴스레터

본 뉴스레터의 모든 내용은 공개된 정보를 기반으로 한 개인적인 의견이며, 투자 조언이 아닙니다.